Un robot no hará daño a un ser humano

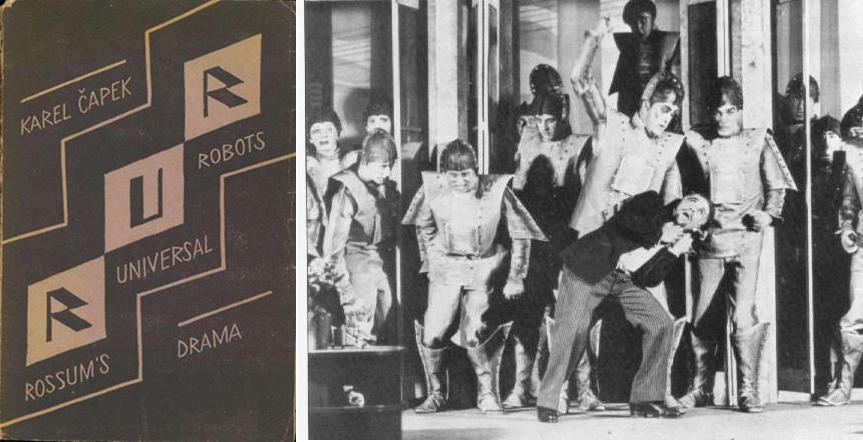

La palabra «robot» viene del checo robota, que significa ‘esclavo’, y esto ya dice mucho acerca de lo que Karel Čapek tenía en mente cuando escribió R. U. R. en 1920 —aunque sus robots eran orgánicos, no mecánicos—. Las máquinas, sobre todo a partir de la Segunda Revolución Industrial, cuando el progreso tecnológico fue imparable, estaban para trabajar y para servirnos, y de paso, para realizar todas aquellas tareas ingratas que nosotros no queríamos hacer. De ahí todas aquellas historias en las que acababan rebelándose. Si alguna vez llegaban ser tan sofisticadas como nosotros, ¿por qué no iban a reclamar el mismo trato y derechos?

El propio contexto histórico, político y social convirtió al robot en ese símbolo de rebeldía —la de la clase obrera, en realidad—, pero esto no debería sorprendernos: cualquier narrativa y, probablemente más que ninguna, la ciencia ficción, es sensible a las actitudes y corrientes de pensamiento de cada época. En un momento en el que la tecnología había empezado a modelar la sociedad —al contrario de lo que había sucedido hasta el momento—, era inevitable que su mera existencia despertara algún tipo de reacción.

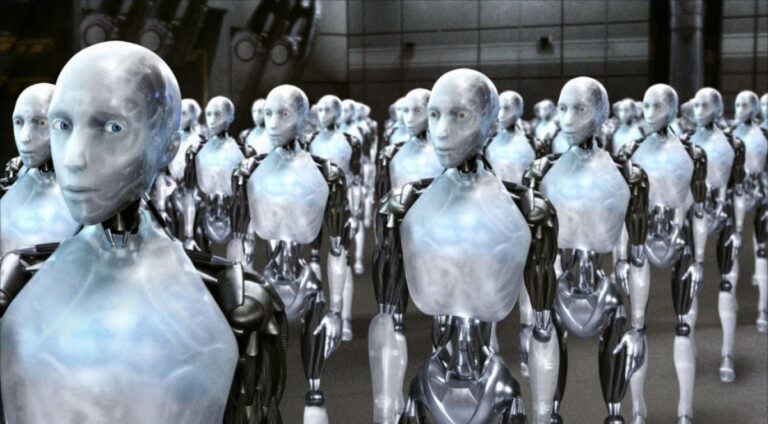

Los robots, simplemente, se convirtieron en uno de los mayores exponentes del desarrollo tecnológico, en la metáfora perfecta que aunaba en una misma entidad lo artificial y lo natural, o «lo humano» —sea lo que sea eso—. Y durante mucho tiempo, no fuimos muy amables con ellos: los robots eran «lo otro», «lo diferente», «lo desconocido», «lo minoritario»… algo que, quién sabe, podría llegar a suponer un día un desafío y una amenaza de la que tal vez no podríamos salir indemnes, precisamente porque tenían el potencial de parecerse demasiado a nosotros.

Pero esa imagen se empezó a transformar a medida que la vida de toda una generación, nacida alrededor de los albores del siglo XX, mejoraba gracias al progreso. Hoy, tener agua corriente, electricidad, teléfono —e internet—, televisión, etc., nos parece de lo más natural. Entonces no lo era. Hace no tanto hubo personas que nacieron en un mundo en el que no existían los aviones y murieron tras ver, por primera vez, a un ser humano, pisar la Luna. ¿Cómo no iban a acoger la ciencia y la tecnología con los brazos abiertos? También a los robots.

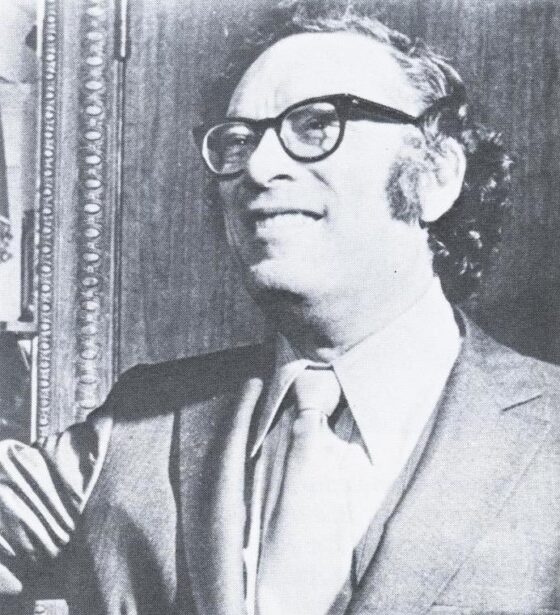

Así, a finales de los años treinta, empezaron a proliferar historias en las que estos empezaban a mostrar verdaderas emociones y anhelos humanos, y aparecían vulnerables e incluso se comportaban de forma emocional. En ese contexto, Isaac Asimov recogió el testigo y transformó por completo la imagen que hasta entonces se había tenido del robot:

Escribí mi primera historia de robots, «Robbie», en mayo de 1939, cuando solo tenía diecinueve años.

Lo que la diferenciaba de otras historias similares escritas con anterioridad era mi determinación de no convertir a mis robots en símbolos. No debían representar la arrogancia desmesurada de la humanidad. No debían ser ejemplos de ambiciones humanas que traspasaban el dominio del Todopoderoso. No debían convertirse en una nueva Torre de Babel que mereciera recibir un castigo.

Tampoco debían simbolizar a grupos minoritarios. No debían ser criaturas patéticas perseguidas injustamente para que yo pudiera hacer declaraciones esópicas sobre judíos, negros o cualquier otro miembro oprimido de la sociedad. Naturalmente, me oponía firmemente a tal opresión y lo dejé claro en numerosos relatos y ensayos, pero no en mis historias de robots.

En ese caso, ¿qué hice con ellos? Los convertí en dispositivos de ingeniería. Los convertí en herramientas. Los convertí en máquinas que servían a fines humanos. Y los creé con funciones de seguridad integradas. En otras palabras, los configuré para que no pudieran matar a su creador, y tras prohibir ese cliché tan manido, pude considerar otras consecuencias más racionales.

Su planteamiento de las tres leyes de la robótica[1] —reconocimiento que siempre intentó, sin éxito, compartir con el editor John W. Campbell—, dotando a los robots y, por extensión, a la tecnología, de una ética, abrió nuevas formas de pensar y de enfrentarnos a un progreso que empezaba a acelerarse tanto que daba vértigo. Y, sobre todo, puso el foco en las cuestiones morales y éticas que emergen del desarrollo científico teórico y aplicado. Nuestra responsabilidad, como creadores, sobre ello. Isaac Asimov intentó cambiar deliberadamente el relato para mostrar que otro tipo de futuros y otro tipo de relación con la tecnología era posible si existía voluntad para ello, y dirigió el foco hacia nosotros para conseguirlo. La decisión estaba en nuestras manos.

Los robots de Asimov, así, ya no eran armas potenciales, sino herramientas e incluso compañeros. Y muchas veces eran más humanos incluso que los propios seres humanos que compartían trama con ellos —al menos, si fuera posible eliminar la maldad del corazón de las personas como él hace en los cerebros positrónicos de sus máquinas—.

No obstante, y como era de esperar, el optimismo de las primeras historias de robots que escribió Isaac Asimov no pudo escapar de los cambios de su tiempo. La Segunda Guerra Mundial ejemplificó, como ninguna otra circunstancia hubiera podido hacerlo, qué es lo que sucede cuando no existen «tres leyes de la robótica» que guíen nuestras creaciones, y sus narraciones, como las de tantos otros, se volvieron más sombrías. Sin embargo, esto no fue fruto de la desconfianza en la tecnología, sino que se debió a la pérdida de fe en la humanidad y en que siempre decidirá lo mejor para el bien común. Así, Néstor, o NS-2, el protagonista de «Pequeño robot perdido» (1947), está programado con una primera ley de la robótica modificada —puede quedarse inactivo mientras un ser humano sufre daño—, lo que es posible que ejemplifique que los seres humanos no solo no vayamos a estar nunca conformes con nada que consigamos —¿qué necesidad hay de crear tecnología potencialmente peligrosa si, además, sabemos que lo es?—, sino que nunca lo estaremos aun cuando pongamos en riesgo con ellos nuestra propia existencia.

Para terminar, y como suele pasar en ciencia ficción, ni los robots son robots ni este artículo habla sobre ellos. Se trata de nosotros. La ciencia, como no podría ser de otra manera, es un reflejo indiscutible de lo que somos, pero el espejo donde podemos verlo es, una vez más, el ámbito de las humanidades.

Bibliografía

Asimov, I. (marzo de 1947). Little lost robot. Astouding Science Fiction.

Asimov, I. (1987). My robots. Odyssey. Ace Books.

Stableford, B., Langford, D. y Clute, J. (2024). Robot. The encyclopedia of science fiction.

Stableford, B. (2006). Encyclopedia of science fact and science fiction.

[1] Doy por hecho que cualquier que esté leyendo este artículo las conoce, pero son estas:

I. Un robot no hará daño a un ser humano, ni por inacción permitirá que un ser humano sufra daño.

II. Un robot debe cumplir las órdenes dadas por los seres humanos, a excepción de aquellas que entren en conflicto con la primera ley.

III. Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera o con la segunda ley.

Sobre la autora: Gisela Baños es divulgadora de ciencia, tecnología y ciencia ficción.