Una breve historia de la inteligencia artificial

Es posible que la historia de la inteligencia artificial se remonte a tiempos tan antiguos como los de la historia humana… al menos si entendemos que el desarrollo científico y tecnológico empieza con una idea. Y es que la idea de crear seres vivos artificiales, e incluso con discernimiento propio, se remonta a Homero. Sin embargo, si queremos ceñirnos a la inteligencia artificial como disciplina, no hace falta irse tan atrás en el tiempo.

Seguramente, llegados a este punto, la mayoría haya pensado en Alan Turing, o tal vez en la conferencia de Dartmouth y, ni por asomo, en Leonardo Torres Quevedo, pero es posible que la inteligencia artificial le deba al ingeniero español más de lo que muchos piensan. En sus «Ensayos sobre automática» (1914), dejaba una visión, y un testigo, que la generación que estaba en el colegio en ese momento se encargaría de recoger:

Además, se necesita —y este es el principal objeto de la automática— que los autómatas tengan discernimiento, que puedan en cada momento, teniendo en cuenta las impresiones que reciben, y también, a veces, las que han recibido anteriormente, ordenar la operación deseada. Es necesario que los autómatas imiten a los seres vivos, ejecutando sus actos con arreglo a las impresiones que reciban y adaptando su conducta a las circunstancias.

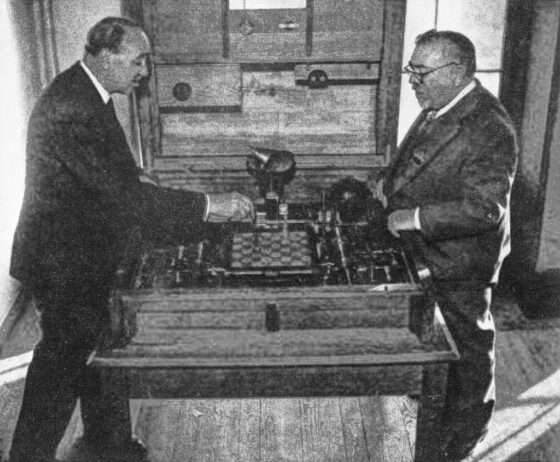

Teniendo en cuenta que, apenas tres años antes, había construido su ajedrecista —un juego de ajedrez completamente automático capaz de decidir por sí mismo cuál era la jugada más apropiada para ganar la partida— da la impresión de que, si la historia de la inteligencia artificial no comenzó con Torres Quevedo fue porque aún no tenía los medios técnicos necesarios a su alcance.

Créditos: Dominio público.

Esos medios vinieron de Alan Turing, y de Claude Shannon, y de John von Neumann, y de Norbert Wiener… y, en definitiva, de todos los padres de la computación moderna que, incluso con máquinas que se encontraban a años luz de los ordenadores que tenemos ahora, ya supieron entrever muchas de sus posibilidades. La generación que los siguió es la que, por fin, materializarlas.

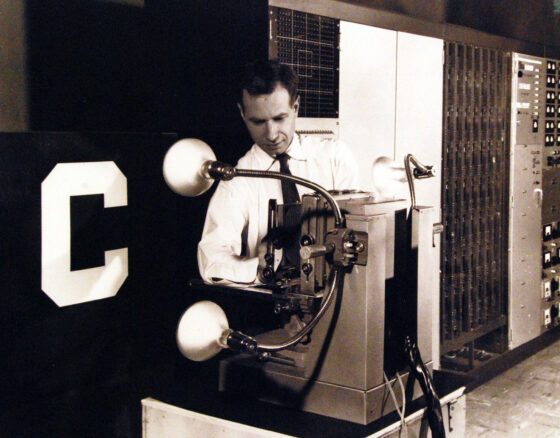

Es entonces cuando de verdad empezó todo. Un joven John McCarthy llegó a los Bell Labs para trabajar durante el verano de 1952, siguiendo los pasos de su ídolo Claude Shannon, y le propuso escribir el que sería uno de los primeros trabajos académicos en el ámbito de la inteligencia artificial (cuando ni siquiera tenía ese nombre, sino Automata studies), pero se dio de bruces contra el choque generacional. Aquella recopilación de artículos acabó centrándose demasiado en la automática clásica de sistemas electromecánicos, y McCarthy quería llevar el concepto de máquinas pensantes a un nivel mucho más abstracto. Tres años después, cuando recaló como profesor de matemáticas en la Universidad de Dartmouth, dio el paso y empezó a organizar un seminario de verano que pretendía reunir a los pocos expertos en un área de conocimiento que, entonces, no tenía ni nombre.

No podía jurar que no lo hubiera oído antes, pero inteligencia artificial no era una frase particularmente prominente. Alguien la debió utilizar en un artículo o una conversación o algo así. En todo caso, había muchas otras expresiones de moda en ese momento. La Conferencia de Dartmouth hizo que esa predominara sobre las otras.

Y así quedó recogido en A proposal for the Dartmouth summer research project on artificial intelligence, que, no sin ciertas dificultades, consiguió la financiación necesaria para celebrarse durante el verano de 1956.

Esta es la fecha que se suele tomar de referencia para lo que, con posterioridad, se conoció como «primer verano» de la inteligencia artificial, aunque se podría considerar que empezó unos años antes. Se trató de un período de optimismo y grandes promesas en un campo en el que todavía estaba todo por hacer. Comenzó, así la era dorada de la inteligencia artificial simbólica —basada en la lógica formal—, pero pronto se dio de bruces con el primer problema: la falta de resultados y, por tanto, de financiación.

Es habitual que prime el entusiasmo ante la eclosión de una nueva ciencia, pero a veces hay demasiado. Cuando todos los caminos están por explorar, todavía no se sabe cuáles están cortados, así que en aquel entonces muchos infravaloraron las dificultades a las se tendrían que enfrentar a medida que desarrollaban aquellos algoritmos. Alguno, como Herbert Simon,[1] se atrevió a aventurar que una IA general estaba a la vuelta de la esquina: «Tecnológicamente […], las máquinas serán capaces, dentro de veinte años, de realizar cualquier trabajo que un ser humano pueda realizar». Teniendo en cuenta que lo dijo en 1960, es obvio que tiró las campanas al vuelo demasiado pronto.

Aun así, aquellos sistemas simbólicos funcionaban, y lo hacían muy bien siempre que se aplicaran a tareas relativamente simples. Tengamos en cuenta que, en aquel momento, los ordenadores eran de segunda generación, esto es, ya utilizaban transistores, pero no pasaban de unos cientos de miles de operaciones por segundo y tampoco eran, ni mucho menos, accesibles. A medida que se intentaban incorporar nuevos factores y variables a los algoritmos, la complejidad crecía exponencialmente, limitando el nivel de desarrollo que se podía alcanzar de una forma práctica.

El trabajo de aquellos pioneros tampoco estuvo exento de críticas, que empezaron a llegar desde numerosos frentes, sobre todo desde el de las humanidades. Muchas voces intelectuales se alzaron para señalar, y de forma muy agresiva en algunos casos, que la inteligencia artificial era una entelequia irrealizable por numerosos motivos —muchos de ellos giraban en torno a la definición de ser humano y su papel en el mundo, algo que una máquina jamás sería capaz de imitar—. El informe que el Gobierno británico le encargó al matemático James Lighthill y que resultó bastante desfavorable, terminó de darle la puntilla a aquella etapa.

Fin del primer verano

Aun así, el trabajo no cayó en saco roto. El fin del primer verano se debió más a las limitaciones técnicas que a la falta de ideas, y es que las primeras redes neuronales nacieron también en este momento: el modelo de neurona de Warren McCulloch y Walter Pitts data de 1943; la primera red neuronal que se conoce, SNARC, de Marvin Minsky, es de 1951, y el Perceptrón, de Frank Rosenblatt, de 1957. Curiosamente, las redes neuronales se empezaron a desarrollar incluso antes de que la inteligencia artificial empezara a llamarse así —la disciplina todavía estaba bajo la influencia de la cibernética—, pero han sido el último de los avances en implantarse. Incluso Alan Turing hizo el intento de programar una en su rudimentario ordenador de Mánchester en aquellos años.

Llegó entonces el primer invierno, algo más de un lustro sin financiación y sin avances significativos hasta que, a principios de los años ochenta, la mejora de los sistemas informáticos y, sobre todo, el uso práctico, y rentable, que se le podía dar a esos algoritmos, despertó de nuevo el interés por ellos.

Segundo verano

Si la inteligencia artificial había permanecido, durante el primer verano, en el ámbito académico, durante el segundo llegaría al empresarial a través de los denominados «sistemas expertos». Los primeros algoritmos tenían aplicaciones muy restringidas, pero eso dejó de verse como un problema. No hacían falta sistemas que supieran hacer de todo, bastaba con que supieran hacer aquello para lo que se los necesitaba: predecir la forma de moléculas orgánicas (DENDRAL), identificar las bacterias causantes de una infección (MYCIN), ayudar al montaje de ordenadores (R1/XCON) e incluso ayudar en el proceso de esterilizado de sopas y los problemas que podía presentar. La inteligencia artificial parecía ahora un negocio que podía llegar a ser muy lucrativo y la financiación comenzó a llegar, además de fuentes gubernamentales, de empresas del sector privado y capital riesgo.

Pero, de nuevo, se dieron de bruces con el muro de hielo.

Los sistemas expertos no utilizaban una tecnología distinta a la que se había utilizado durante las primeras décadas. Simplemente, los ordenadores habían mejorado… aunque no lo suficiente.

En un mundo sin internet ni el acceso a los datos que tenemos en la actualidad, mantener actualizado un sistema experto suponía un coste bastante alto —había que introducir todo a mano—. Y, por otro lado, tratar de ampliarlos era un quebradero de cabeza que se daba de nuevo de lleno con el problema de la complejidad: la tecnología, aunque más avanzada, seguía imponiendo sus límites. Además, a medida que crecían, los algoritmos se volvían inestables, y ofrecían resultados erróneos e inesperados que los técnicos no podían explicar. Podían resultar muy útiles en muchos aspectos, pero, en el fondo, cualitativamente, no había cambiado casi nada.

El segundo invierno de la inteligencia artificial fue, más bien, una glaciación que duró más de dos décadas, desde 1988 hasta 2011. Aunque en este período se produjeron algunos logros notables, como la victoria al ajedrez de Deep Blue sobre Garri Kasparov en 1997, la inteligencia artificial se convirtió en un campo de estudio minoritario. Sin embargo, aunque discretos, continuaron los avances.

Empezaron a aparecer los primeros modelos de razonamiento probabilístico, como las redes bayesianas; también hubo movimiento en el ámbito de las redes neuronales, que habían quedado prácticamente abandonadas desde la época del perceptrón —Rosenblatt falleció al poco tiempo en un accidente naútico y no pudo continuar con sus investigaciones—. Llegaron las redes neuronales recurrentes y, sobre todo, el redescubrimiento y uso del algoritmo de backpropagation[2] por parte de Geoffrey Hinton, David Rumelhart y Ronald Williams, para entrenar redes multicapa —ahora sí existía tecnología lo suficientemente potente como para crearlas—. En los albores de la segunda década del siglo XXI, todo estaba listo para que llegara un nuevo boom de la inteligencia artificial. La diferencia con los dos veranos anteriores es que, en esta ocasión, estos sistemas serían accesibles para todo el mundo.

El verano popular la inteligencia artificial

El concurso de reconocimiento de imágenes AlexNET, que ganaron Alex Krizhevsky, Ilya Sutskever y Geoffrey Hinton en 2012 mostró lo que la inteligencia artificial, y la tercera generación de redes neuronales, podía ser capaz de hacer. A partir de entonces, con el desarrollo del deep learning, la complejidad se disparó y el punto de inflexión —además de los nuevos algoritmos y un incremento, una vez más, en la capacidad computacional— lo marcó la disponibilidad y la facilidad de acceso a los datos que la expansión de internet y la digitalización trajeron consigo. El 30 de noviembre, OpenAI lanzó ChatGPT… y creo que el resto no hace falta contarlo, lo estamos viviendo en estos momentos.

Si después de este verano llegará otro invierno es algo difícil de saber. Si bien es cierto que el entusiasmo y la expectación parece que se nos han vuelto a ir de las manos, es innegable que, en esta ocasión, hay un factor bastante diferenciador: el uso de sistemas de inteligencia artificial se ha democratizado. Decía William Gibson que «La calle encuentra sus propios usos para las cosas». Durante los dos primeros veranos, los algoritmos de inteligencia artificial se programaban con unos fines muy concretos —tampoco se podía hacer otra cosa—, pero ¿y ahora? No solo tenemos herramientas mucho más versátiles, sino mucha más gente con acceso a ellas, y la historia nos ha demostrado en innumerables ocasiones lo impredecibles que pueden llegar a ser las aplicaciones de un nuevo tipo de tecnología.

Probablemente, esta vez, como dice Henry A. Kautz «Se aproxima una época de clima agradable de verano, un alivio después de la actual ola de calor». En cualquier caso, cuando una herramienta llega a nuestras vidas, de una manera u otra, suele hacerlo para quedarse.

Bibliografía

Baños, G. (2024). El sueño de la inteligencia artificial. Shackleton Books.

Kautz, H. A. (2021). The third AI summer: AAAI Robert S. Engelmore Memorial Lecture. AI Magazine, 43(1), 105-125. https://doi.org/10.1002/aaai.12036

Torres Quevedo, L. (1917). Mis inventos y otras páginas de vulgarización. Editorial Hesperia.

Notas:

[1] Poco antes de la Conferencia de Dartmouth, Herbert Simon había creado, junto con Allen Newell y John Clifford haw, el Logic Theorist, un algoritmo simbólico capaz de demostrar algunos de los teoremas matemáticos que aparecían en los Principia mathematica, de Bertrand Russell.

[2] Paul Werbos ya lo propuso en su tesis doctoral en 1974, pero en aquel momento pasó desapercibido.

Sobre la autora: Gisela Baños es divulgadora de ciencia, tecnología y ciencia ficción.

David

Un artículo muy bien construido, y que hace un repaso muy clarificador por el tema. Muchas gracias, Gisela.