De la entropía

Posiblemente pocas ideas científicas tan fundamentales tengan más expresiones diferentes que la segunda ley de la termodinámica. Una que no suele emplearse demasiado pero que encierra en una sola frase su esencia se debe a Ludwig Boltzmann que, parafraseando a Josiah Willard Gibbs, dijo: “La imposibilidad de una disminución no compensada de la entropía parece estar reducida a una improbabilidad”. Y es que el concepto de entropía está en el centro de la termodinámica, y en el de la evolución del universo.

El origen del concepto de entropía tiene está en una paradoja planteada por William Thomson (más tarde lord Kelvin) en 1847: la energía no puede crearse ni destruirse, sin embargo la energía térmica pierde su capacidad de realizar trabajo (por ejemplo, levantar un peso) cuando se la transfiere de un cuerpo caliente a uno frío. En 1852 Thomson sugirió que en un proceso como la conducción del calor la energía no se pierde sino que se “disipa” o deja de estar disponible. Además, la disipación, según Thomson, es equivalente a una ley natural que expresa la “direccionalidad” de los procesos naturales.

William Macquorn Rankine y Rudolf Clausius propusieron sendos conceptos que representaban la misma tendencia de la energía hacia la disipación. Llamado inicialmente “función termodinámica” por Rankine y “disgregación” por Clausius , sería éste el que le diese su nombre definitivo en 1865, entropía, a partir de a palabra griega para transformación. Cada proceso que tiene lugar en un sistema aislado aumenta la entropía del sistema.

Así, Clausius formuló la primera y la segunda leyes de la termodinámica en su frase “La energía del universo es constante, y su entropía tiende a un máximo”. De esta simple expresión se deduce que el universo terminará alcanzando una temperatura uniforme, que no habrá energía disponible para realizar trabajo y que el universo sufrirá, por tanto, una lenta “muerte térmica”.

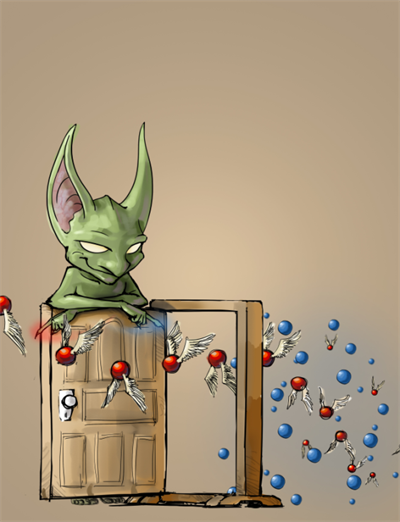

En 1871 James Clerk Maxwell publicó un experimento mental intentando demostrar que no siempre el calor tiene que fluir de un cuerpo a mayor temperatura a otro a menor. Un agente microscópico ( que Thomson bautizaría después como “el demonio de Maxwell”) controlando una trampilla en una pared que separa un gas frío de otro caliente, podría elegir dejar pasar sólo aquellas moléculas del gas que se muevan más rápidamente de lo que lo hacen el promedio de las moléculas del gas caliente. De esta manera el calor iría del gas frío al gas caliente. Este experimento mental venía a indicar que la “disipación” no era algo inherente en la naturaleza, sino que surgía de la inhabilidad humana de controlar los procesos microscópicos. La segunda ley de la termodinámica tiene sólo un valor estadístico; en regiones macroscópicas la entropía casi siempre aumenta.

Boltzmann intentó resolver un problema apuntado por Joseph Loschmidt en 1876, y por Thomson dos años antes, que ponía en peligro la interpretación mecánica de la termodinámica en general y de la segunda ley en particular. Esta ley sugiere que existe una asimetría en el tiempo que rige los procesos físicos; el paso del tiempo tiene como consecuencia un cambio irreversible, el incremento de entropía. Sin embargo, si las leyes de la mecánica aplicasen a los constituyentes de los sistemas termodinámicos, su evolución debería ser reversible, ya que las leyes de la mecánica son las mismas tanto si el tiempo fluye hacia delante como si lo hace hacia atrás; las leyes de Newton pueden decirnos donde estaba la Luna hace mil años con tanta exactitud como dónde estará dentro de mil a partir de ahora. A primera vista, no parece existir una correspondencia mecánica para la segunda ley de la termodinámica.

No sería hasta 1877 que Boltzmann encontró una solución a esta dificultad interpretando la segunda ley en el sentido del demonio de Maxwell. Según el cálculo de Boltzmann a cada estado macroscópico de un sistema corresponden muchos microestados (distribuciones concretas de la energía entre las moléculas del sistema) que Boltzmann consideraba que eran igualmente probables. Por lo tanto la probabilidad de un macroestado dependerá del número de microestados que se corresponden con él. A continuación Boltzmann identificó la entropía de un sistema como una función logarítmica de la probabilidad de su estado macroscópico. Con esta interpretación , la segunda ley afirmaba que los sistemas termodinámicos tienen tendencia a evolucionar hacia los estados más probables. Una disminución de entropía es improbable, pero no imposible.

En 1906 Walther Nernst formuló su teorema del calor que decía que si tenía lugar un cambio químico entre sólidos cristalinos puros en el cero absoluto no debería haber cambio de entropía. La formulación más general de este teorema es lo que se conoce como tercera ley de la termodinámica: es imposible enfriar un cuerpo hasta el cero absoluto por un proceso finito y en el cero absoluto todos los cuerpos tienen la misma entropía, que puede igualarse arbitrariamente a cero.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

De la entropía

[…] De la entropía […]

De la entropía | Experientia docet | Cua…

[…] Posiblemente pocas ideas científicas tan fundamentales tengan más expresiones diferentes que la segunda ley de la termodinámica. Una que no suele emplearse demasiado pero que encierra en una sola frase su esencia se debe a Ludwig […]

Termodinámica | Annotary

[…] culturacientifica.com […]

#De la entropía | Experientia docet

[…] Continúa leyendo en el Cuaderno de Cultura Científica […]

Hitos en la red #11 | Naukas

[…] Por cierto, este cronista aprovecha la oportunidad para recordar que las leyes primera, segunda y tercera son leyes y no principios porque tienen base experimental, se construyen fenomenológicamente. Con objeto de tener una consistencia formal Fowler introdujo el principio cero, y este sí es principio, que no ley. De todas ellas el concepto a veces más escurrridizo es el de entropía, cuyo desarrollo histórico aparece como parte de la serie #De en De la entropía. […]

De la entropía | Artículos CIENCI…

[…] Posiblemente pocas ideas científicas tan fundamentales tengan más expresiones diferentes que la segunda ley de la termodinámica. Una que no suele emplearse demasiado pero que encierra en una sola frase su esencia se debe a Ludwig […]

Hector04 (@hector_denis)

Ese Boltzman tuvo ayuda de planck gracias a ellos se relacionó los mircoestados con estados macroscopicos, es decir, incursionaron en los fenómenos emergentes y los factores de escala, este factor de escala que es la constante de boltzmann usó planck increiblemente para relacionar dos mundos, una definición adimensional de la entropía también fue descrita en la teoría de la información.

jordi prat

propongo que se enseñe en las facultades de economicas , mas que nada para que dejen de decir sandeces y que dejen de llamarse ciencias economicas , para llamarse magufadas economicas

Aprender a fluir – AMADAG

[…] El universo tiende a la entropía, es decir, tiende al desorden, sin embargo, frente a esto, nos podemos defender con una norentropia , nos podemos defender en una búsqueda del orden. Si logramos reconocer una serie de patrones, eso nos va a ayudar a incrementar nuestras posibilidades de supervivencia. […]